Spadek ruchu SEO to jeden z najbardziej stresujących momentów w pracy każdej agencji i zespołu in-house. Po 2-3 latach stabilnej organicznej obecności nagle widać, że sesje spadają 20-40% z tygodnia na tydzień. Pierwsza reakcja większości zespołów – panika, wymienianie domysłów, zmienianie rzeczy na oślep – zawsze kończy się gorzej niż metodyczna diagnostyka. Ten tekst pokazuje, jak w 30 dni systematycznie zdiagnozować przyczynę spadku i wdrożyć plan naprawy.

Kluczowa zasada: spadek ruchu SEO w 95% przypadków ma konkretną, identyfikowalną przyczynę. To nie „kaprys Google”. To algorytm reagujący na zmiany (Wasze lub konkurencji) albo na nową aktualizację. Diagnostyka to proces, a nie zgadywanie.

W skrócie

- Spadek ruchu SEO ma zwykle 5-7 typowych przyczyn: core update Google, kanibalizacja, utrata backlinków, problem techniczny, content decay, zmiana intencji, spadek pozycji w konkretnych frazach.

- Pierwsze 7 dni: diagnostyka. Bez niej zmiany są losowe. Używajcie Search Console, GA4, Ahrefs/Semrush równolegle.

- 30-dniowy plan naprawy dzieli się na: tydzień 1 – diagnostyka, tydzień 2 – quick wins, tygodnie 3-4 – deeper fixes, kontynuacja w następnych miesiącach.

- Realistyczne oczekiwanie: pełne odzyskanie ruchu zajmuje 2-6 miesięcy od naprawy. Cudownego jednodniowego rebound’u nie ma.

- Najczęstszy błąd: zmienianie wielu rzeczy jednocześnie. Gdy ruch wraca, nie wiecie, co zadziałało – i nie odtworzycie sukcesu następnym razem.

Pierwsze 24 godziny: nie panikować, zebrać fakty

Moment, w którym zauważacie spadek ruchu, to najważniejsze 24 godziny w całym procesie naprawy. Konkretna checklista na ten czas:

Krok 1 – zweryfikujcie, że spadek jest realny. Dziwne, ale pierwsza rzecz do sprawdzenia: czy wasze narzędzie analityczne działa poprawnie. W 5-10% przypadków „spadek ruchu” to błąd pomiarowy – nie zadziałał tracking, ktoś zmienił konfigurację GA4, strona się przesunęła do innej property. Sprawdźcie: czy JavaScript tracking jest na stronie, czy Google Tag Manager działa, czy GA4 zbiera dane poprawnie dla wszystkich źródeł ruchu.

Krok 2 – zmapujcie zakres spadku. Czy spada wszystek ruch (organic, direct, paid)? Jeśli tylko organic – to problem SEO. Jeśli wszystkie kanały naraz – to problem strony (np. padł serwer albo hosting). Jeśli organic spada, ale paid i direct rosną – może być kanibalizacja między kanałami. Każde z tych przypadków wymaga innego rozwiązania.

Krok 3 – zaznaczcie baseline. Zapiszcie liczby: sesje dzienne przed spadkiem (średnia 30-dniowa), sesje dzienne obecnie, procentowy spadek, średnia pozycja z GSC przed i teraz, CTR przed i teraz. Ten zapis będzie punktem odniesienia przez następne miesiące.

Krok 4 – sprawdźcie, czy konkurencja też spada. Spadek tylko Was – problem jest specyficzny dla Waszej domeny. Spadek całej branży – może być core update Google, zmiana zachowania użytkowników, sezonowość. To dramatycznie różne scenariusze.

Pierwsze 24 godziny kończą się jednostronicowym raportem: co widzimy, w jakim zakresie, co wiemy, czego nie wiemy. To dokument, który pokazujecie zespołowi/zarządowi i na podstawie którego decydujecie o następnych działaniach. Bez tego pierwszego zebrania faktów reszta diagnostyki to chaos.

Audyt tej rangi warto robić systematycznie na podstawie pełnej listy kontrolnej audytu SEO na 2026. Kiedy przychodzi kryzys, checklist daje strukturę, żeby nic nie przeoczyć.

Siedem typowych przyczyn spadku ruchu: diagnostyka w tydzień

Pierwsze 7 dni to systematyczne wykluczanie przyczyn. Każda z 7 głównych ma charakterystyczne symptomy – można je zidentyfikować w kilka godzin.

1. Core update Google

Charakterystyka: nagły spadek (z dnia na dzień albo w 2-3 dni), zwykle skorelowany z oficjalnie ogłoszoną aktualizacją (Search Status Dashboard, Twitter Google). Dotyczy często szerokich kategorii stron (np. YMYL, portale afiliacyjne, strony z low-quality content).

Jak sprawdzić: zobaczyć Search Status Dashboard (bug.google/search/status) i porównać daty. Sprawdzić Semrush Sensor albo MozCast – narzędzia pokazujące „volatility” SERPów. Jeśli cała branża w Semrush Sensor pokazuje wysoki volatility w tych samych dniach – potwierdzenie.

Co robić: core update wymaga długofalowej strategii (3-6 miesięcy), nie quick fixów. Analiza, które strony straciły najbardziej (zwykle te z słabym E-E-A-T, cienkim content, AI-generated bez edycji). Plan poprawy tych kategorii stron.

2. Kanibalizacja słów kluczowych

Charakterystyka: spadek ruchu na konkretnych frazach, ale CTR spadł znacznie mocniej niż pozycje. Ahrefs/Semrush pokazuje, że dla tej samej frazy rankują 2-3 Wasze URL-e.

Jak sprawdzić: w GSC lista top fraz, dla każdej sprawdźcie „Top pages” – czy dla frazy X Google pokazuje raz URL A, raz URL B. Jeśli tak, kanibalizacja.

Co robić: decyzja kanibalizacyjna – konsolidacja (dwa URL-e w jeden, 301 redirect), albo wyraźne rozdzielenie intencji (przepisanie jednego z artykułów na inną frazę).

3. Utrata backlinków

Charakterystyka: stopniowy spadek (tygodnie, nie dni), często dotyczy konkretnych stron, które miały najwięcej linków. Pozycje spadają nie z pierwszej na 50, tylko z 3-5 na 10-15.

Jak sprawdzić: Ahrefs/Semrush „Lost Backlinks” w ostatnich 90 dniach. Jeśli straciliście znaczące linki (DR 50+, tematycznie relewantne) – prawdopodobna przyczyna.

Co robić: reach out do właścicieli stron z próbą odzyskania (często „link został usunięty przez przypadek przy redesign”). Budowanie nowych backlinków zamiast straconych. Analiza, czy straciliście linki „naturalnie” (strona źródłowa zmieniona) czy negatywnie (ktoś systematycznie je usuwa).

4. Problem techniczny (indeksacja, crawl)

Charakterystyka: spadek widoczności wielu stron naraz, GSC raportuje problemy w Coverage albo Indexing. Bywa ostry (40-60% spadek w kilka dni).

Jak sprawdzić: Search Console -> Coverage/Indexing. Czy liczba indexed pages spada? Są nowe błędy (5xx, 4xx, soft 404)? Robots.txt nie został przypadkiem zmieniony? Canonical tags prawidłowe?

Co robić: natychmiastowa naprawa techniczna. Jeśli robots.txt blokuje ważne katalogi – odblokować. Jeśli 5xx – popracować z hostingiem. Jeśli canonical kieruje na błędne strony – poprawić.

5. Content decay

Charakterystyka: wolny spadek (miesiące, nie tygodnie). Konkretne artykuły, które były top, powoli tracą pozycje. Konkurencja wydała nowsze/lepsze treści.

Jak sprawdzić: sortowanie stron w GSC po „spadkiem ruchu” w ostatnich 12 miesiącach. Jeśli widzicie konkretne top strony, które straciły – to decay.

Co robić: update tych artykułów. Przepisanie z nowymi danymi, świeższymi przykładami, aktualnymi liczbami. To różne od „small refresh” – wymaga rebuild’u.

6. Zmiana intencji wyszukiwania

Charakterystyka: pozycja tej samej, ruch spada. W SERP dla waszej frazy Google pokazuje inne typy wyników niż wcześniej (np. feature snippets z YouTube, shopping ads, AI Overview).

Jak sprawdzić: ręczne sprawdzenie SERPa dla top fraz. Porównanie z tym, co widzieliście 6 miesięcy temu (jeśli macie screenshot albo w pamięci).

Co robić: adaptacja contentu pod nową intencję. Jeśli SERP pokazuje więcej video – dodać video. Jeśli AI Overview cytuje krótki TL;DR – dodać TL;DR na początku artykułu. To kluczowe dla dostosowania do 2026 rynku AIO – szczegóły w przewodniku po SEO on-page 2026.

7. Spadek konkretnych fraz

Charakterystyka: ruch ogólny spada, ale jedno czy dwa URL-e dominują w spadku (80% ruchu straciło 2 top strony).

Jak sprawdzić: GSC -> Pages, sortowanie po zmianie ruchu. Jeśli jasno widać 1-2-3 strony dominujące spadek – rozwiązanie skupia się na nich.

Co robić: indywidualny audyt tych stron. Co się zmieniło w treści? Konkurencja wyszła z czymś lepszym? Backlinki straciły? Techniczny problem specyficzny dla tej strony?

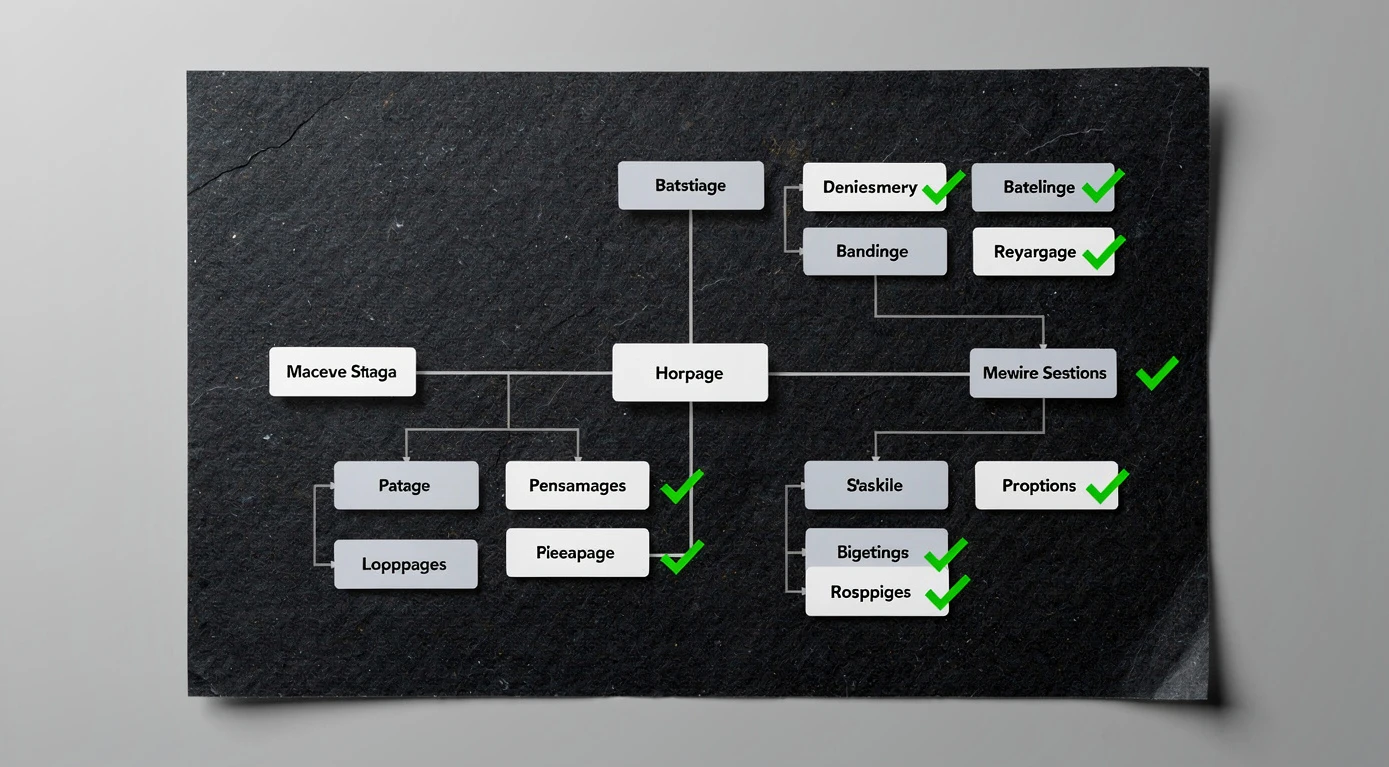

Jak rozróżnić między tymi 7 przyczynami – decyzyjne drzewo

W praktyce często spadek ma 2-3 przyczyny naraz. Ale jedna zwykle jest dominująca. Decyzyjne drzewo pomaga:

- Czy spadek nastąpił w dniach skorelowanych z Google Update? → Przyczyna 1 (core update).

- Czy w GSC -> Pages widać dramatyczny spadek konkretnych URL-i (80%+)? → Przyczyna 7 (konkretne frazy).

- Czy w GSC -> Coverage rosną błędy (5xx, 4xx, soft 404)? → Przyczyna 4 (techniczna).

- Czy dla top fraz w GSC widzicie ten sam URL dla wielu fraz, ale z „płytkimi” pozycjami? → Przyczyna 2 (kanibalizacja).

- Czy Ahrefs/Semrush pokazuje dramatyczny spadek referring domains w 90 dniach? → Przyczyna 3 (backlinki).

- Czy stare top strony (2+ lat) powoli tracą, nowsze rosną? → Przyczyna 5 (content decay).

- Czy ręczne sprawdzenie SERPa pokazuje nową strukturę (AI Overview, feature snippet, shopping)? → Przyczyna 6 (intencja).

Przejście przez tych 7 punktów zajmuje 3-5 godzin dla doświadczonego SEO i prowadzi do 80-90% pewności diagnozy. Pozostałe 10-20% wymagają głębszego research’u – ale przynajmniej macie hipotezę do testowania.

Plan 30-dniowy naprawy

Tydzień 1: diagnostyka (opisana wyżej)

Szczegółowa identyfikacja przyczyn. Dokument z wnioskami.

Tydzień 2: quick wins

Skupienie się na 2-3 najsilniejszych szybkich działaniach. Przykłady:

- Poprawa technicznego problemu wykrytego w tygodniu 1 (odblokowanie robots.txt, naprawa redirectów, reindex przy GSC).

- Konsolidacja kanibalizowanych URL-i (wybór primary, 301 redirect wtórnych).

- Szybki update top 5-10 artykułów, które tracą (dodanie świeżych danych, dopasowanie do aktualnego SERPa).

- Reach out do stron, które usunęły backlinki (jeśli to była przyczyna).

Koszt tygodnia 2: 30-50 godzin pracy zespołu. Wynik: 2-3 „palące” problemy rozwiązane.

Tydzień 3: deeper fixes

Po quick wins przejście do prac wymagających więcej czasu:

- Audyt pełnej kategorii stron, które najmocniej straciły. Plan update’ów na kolejne tygodnie.

- Plan link buildingu / digital PR do odbudowy straconej authority (jeśli backlinki były przyczyną).

- Analiza konkurencji – co oni robią lepiej, że ich content wygrywa teraz.

- Przegląd E-E-A-T: autorstwo, schema, profile autorów, zewnętrzne wzmianki (zwłaszcza po core update).

Koszt tygodnia 3: 20-40 godzin. Wynik: plan długoterminowej naprawy gotowy do realizacji.

Tydzień 4: monitoring i iteracja

Pierwsze wyniki quick winów powinny być widoczne. W GSC i GA4 sprawdzacie:

- Czy ruch dla naprawionych stron wraca?

- Czy spadek się zatrzymał (stabilizacja)?

- Które fixes zadziałały, które nie (iteracja)?

- Czy są nowe symptomy, których nie było tydzień temu?

Na koniec miesiąca raport dla zarządu: co diagnozowaliśmy, co naprawiliśmy, jakie efekty, co planujemy w miesiącach 2-6.

Case: spadek ruchu o 45% po core update, 4 miesiące do pełnej naprawy

Polski portal B2B (IT services) w październiku 2024 przeżywa spadek ruchu z 180 tys. sesji/mc do 100 tys. (-45%). Spadek w 2-3 dniach, skorelowany z Google Helpful Content Update w październiku 2024.

Diagnoza (tydzień 1): core update zidentyfikowany jako główna przyczyna (70% spadku) + kanibalizacja 4 top stron (20% spadku) + utrata 12 backlinków (10% spadku).

Plan:

- Miesiąc 1: quick wins – konsolidacja kanibalizacji, odzyskanie 3 z 12 straconych backlinków. Efekt: wzrost z 100k do 125k sesji.

- Miesiąc 2: audyt E-E-A-T, dodanie stron bio dla 6 autorów, schema Person, przepisanie 15 top stron pod wyższą jakość. Efekt: 125k → 140k.

- Miesiąc 3: rozbudowa topical authority w 2 głównych kategoriach (12 nowych pillars), budowa backlinków (4 nowe z DR 50+). Efekt: 140k → 160k.

- Miesiąc 4: kontynuacja, pierwsze efekty cytowań w AI Overviews dla niektórych tematów. Ruch: 160k → 185k.

Koszt czteromiesięcznej naprawy: ~95 tys. PLN (dedykowany zespół + agencja wsparcia + narzędzia). Wynik: pełne odzyskanie plus 5k „dodatkowego” ruchu vs stan przed spadkiem.

Ten case pokazuje, że spadek z core update nie jest śmiertelny – jest pracochłonny. Z odpowiednią diagnozą i systematyczną naprawą odzyskanie jest realistyczne. Częsty błąd: rzucanie wszystkich sił na jedną rzecz (tylko content, albo tylko linki), zamiast mieć balansowany plan.

Narzędzia potrzebne do diagnostyki spadku

Minimum (bezpłatne): Google Search Console, Google Analytics 4. Dla podstawowej diagnostyki wystarczą – GSC pokazuje pozycje i frazy, GA4 ruch i zachowanie.

Zalecane (płatne): Ahrefs albo Semrush (backlinki, konkurencja, visibility), Semrush Sensor lub MozCast (volatility), Screaming Frog (techniczny audyt), Microsoft Clarity (heatmapy dla analizy engagement).

Specjalistyczne: dla dużych serwisów – dostęp do log serwera (do analizy crawla Googlebota), narzędzia do monitoringu uptime (Pingdom, UptimeRobot).

Dla średniej firmy całość narzędzi: ~600-1200 PLN miesięcznie. Dla diagnostyki jednorazowej można wykupić miesiąc Ahrefs/Semrush, zrobić audyt, i zrezygnować.

Najczęstsze błędy w naprawie spadku ruchu

- Panika i losowe zmiany. „Może to canonical tag, zmieniamy! Może meta description, zmieniamy!” – chaos sprawia, że za 3 tygodnie nie wiadomo, co zmienione i co zadziałało.

- Brak dokumentowania zmian. Zmieniliśmy 15 rzeczy, ale nigdzie nie zapisaliśmy co dokładnie i kiedy. Gdy ruch wraca, nie wiemy, co zadziałało.

- Ignorowanie konkurencji. Spadek nie zawsze jest „winą” Waszej strony – czasem konkurencja wydała coś lepszego. Bez audytu konkurencji nie zrozumiecie rynku.

- Skupienie tylko na technicznym SEO. „To na pewno canonical albo robots”. W 60-70% przypadków problem jest w content quality albo authority, nie w technice.

- Brak cierpliwości. Po 2 tygodniach bez efektów wymienia się cały plan. Realistyczny horyzont to 2-4 miesiące dla większości przypadków.

- Ignorowanie sygnałów user intent. Spadek może być spowodowany zmianą zachowań użytkowników (np. zapytania przenoszą się do LLM-ów). Wtedy klasyczny SEO fix nie pomoże – trzeba adaptacji pod AIO.

- Robienie za dużo naraz. Equity Fix = trzymać się 2-3 najsilniejszych działań naraz. 10 zmian równocześnie to chaos i brak wniosków.

Jak unikać spadków w przyszłości: prewencyjna higiena SEO

Po przejściu kryzysu warto wdrożyć regularne działania zapobiegawcze:

- Miesięczny przegląd GSC + GA4. 2-3 godziny wychwytują większość spadków zanim staną się kryzysowe.

- Kwartalny audyt techniczny (Screaming Frog + PageSpeed Insights). 4-8 godzin, wychwytuje 5xx, soft 404, zepsute redirecty, Core Web Vitals drifting.

- Kwartalny audyt backlinków. Lost backlinks od ostatniego audytu. Próby odzyskania.

- Aktualizacja treści raz w roku per top page. Top 20 stron – raz w roku review i update.

- Monitoring update’ów Google. Ktoś w zespole śledzi Search Status Dashboard i kluczowych influencerów SEO na X.

To ~20-30 godzin pracy kwartalnie, ale oszczędza Wam 60-100 godzin paniki co 2-3 lata, gdy coś się psuje.

FAQ – najczęstsze pytania o spadek ruchu SEO

Ile zwykle trwa pełne odzyskanie ruchu po spadku z core update?

2-6 miesięcy przy aktywnej naprawie. Krócej jeśli przyczyna była techniczna (2-8 tygodni po naprawie). Dłużej jeśli problem to content quality / E-E-A-T (4-9 miesięcy). Cud „ruch wraca jutro” nie zdarza się – Google potrzebuje czasu na ponowne ocenienie jakości. Firmy, które odzyskują 100% ruchu, mają konsekwentny plan i cierpliwość.

Czy warto samodzielnie diagnozować, czy zatrudnić agencję?

Jeśli w zespole jest osoba z 3+ lat doświadczenia SEO – diagnozę można zrobić wewnętrznie. Jeśli nie – 3-5 tys. PLN za audyt od doświadczonego konsultanta zwraca się wielokrotnie, bo daje pewność diagnozy. Najgorsza sytuacja: diagnozujemy sami bez doświadczenia, trafiamy w 50% przyczyn, zmarnujemy 3 miesiące na niewłaściwe fixy.

Czy spadek ruchu tylko na mobile to ten sam problem co na desktop?

Nie zawsze. Spadek tylko mobile to zwykle: Core Web Vitals specyficzne dla mobile (INP, LCP), problem z responsywnością po zmianie layoutu, shopping/ads dominujące mobile SERP (a nie desktop). Diagnoza podobna, ale z naciskiem na mobile-specific elementy. Core Web Vitals 2026 – szczegóły w dedykowanym przewodniku.

Jak odróżnić sezonowy spadek od problemu SEO?

Porównanie rok do roku. Jeśli październik 2025 vs październik 2024 = spadek 30%, to nie sezon (sezon powtarza się każdego roku). Jeśli październik 2025 vs październik 2024 = stabilnie, ale październik 2025 vs czerwiec 2025 = spadek – to prawdopodobnie sezon. Wielu marketerów myli ze sobą te dwa.

Czy warto wysłać Google „Reconsideration Request” przy spadku?

Tylko jeśli macie oficjalny manual action w GSC (widać w „Security & Manual Actions”). Dla algorytmicznych spadków (core update) nie ma procesu odwołania – poprawa strony i czekanie na ponowne ocenienie przez algorytm. Reconsideration Request bez manual action to marnowanie czasu Google’a i Wasz.

Jakie metryki śledzić w trakcie naprawy, żeby wiedzieć, czy idzie dobrze?

Tygodniowe KPI: sesje (czy przestały spadać, czy rosną), impressions w GSC (czy Google widzi więcej Waszych stron), średnia pozycja (trend w kierunku lepszego), CTR (stabilność). Miesięczne: średnie pozycje top 20 fraz, liczba indexed pages, Domain Rating. Jeśli po 4-6 tygodniach trendy są stabilne albo rosnące – naprawa idzie dobrze. Jeśli stabilnie spadają – plan wymaga zmiany.

Co zrobić, gdy klient żąda natychmiastowych efektów, a naprawa wymaga miesięcy?

Transparentna komunikacja od dnia 1: SEO to nie reklama PPC z efektami za 24h. Core update od Google wymaga 2-4 miesięcy na odzyskanie. Tygodniowe raporty z progress pokazują pracę i stopniowe wyniki. Klient, który nie akceptuje tego czasu realizacji, często jest klientem, który źle rozumie SEO – edukacja jest częścią pracy.

Co dalej

Jeśli jesteście w środku spadku ruchu, zacznijcie od pierwszego tygodnia diagnostyki opisanej powyżej. To inwestycja 20-30 godzin, która zapobiega 80% błędów w naprawie. Po ustabilizowaniu sytuacji warto wrócić do podstaw SEO 2026, żeby upewnić się, że fundamenty są solidne, oraz zobaczyć, jak AIO zmienia klasyczny SEO – SEO on-page 2026 pokazuje elementy, które realnie wpływają na rankingi w 2026.